Проблема старых конвейеров в ИИ

Представьте: хотите подогнать под себя инструмент, а вам предлагают либо взять готовый набор целиком, либо лепить всё с нуля. Звучит знакомо? В мире генерации изображений ИИ именно так и было.

Раньше выбор простой: используй стандартный пайплайн без изменений или пиши код заново. Ни грамма гибкости!

LEGO для ИИ: Modular Diffusers

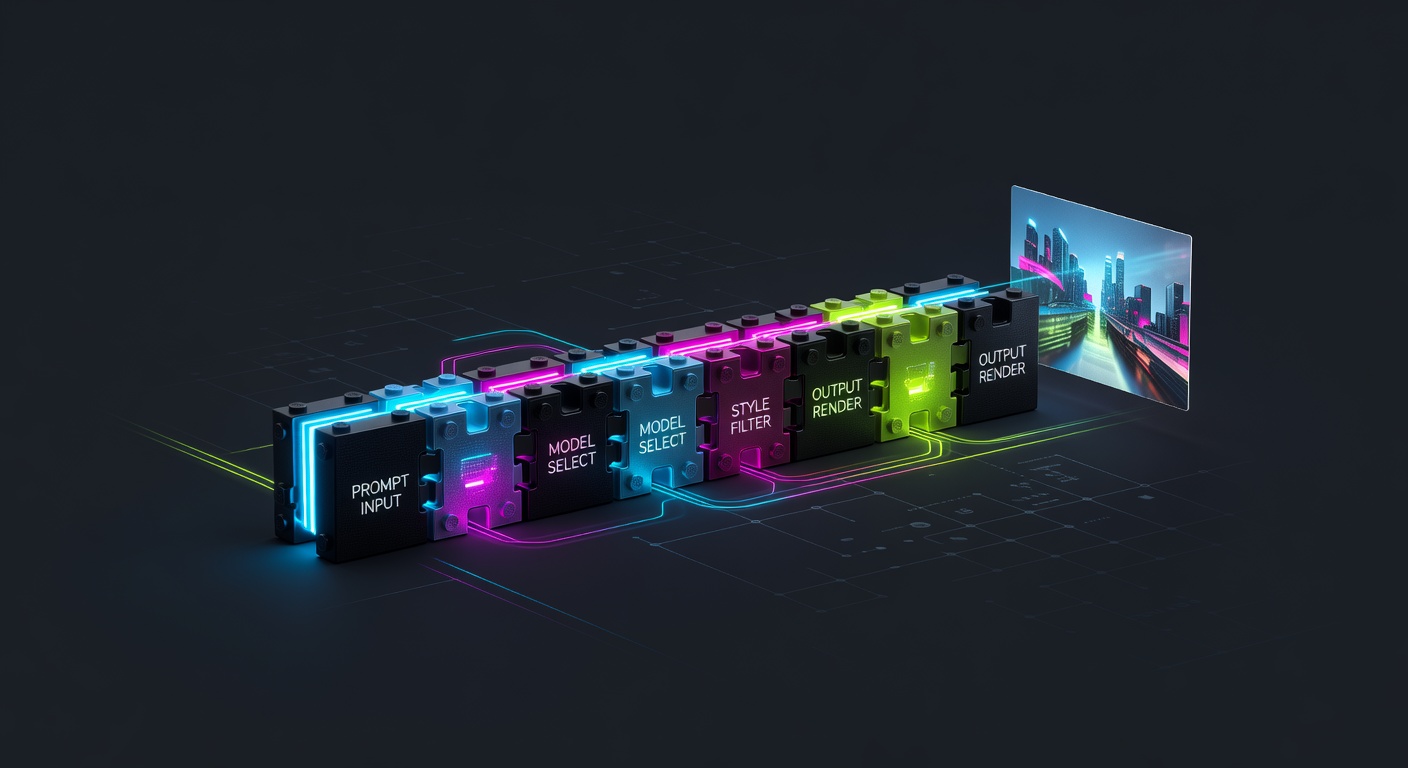

Тут на сцену выходит Modular Diffusers. Это свежий подход, от которого мурашки по коже. Вместо огромного блока они разбили процесс на мелкие "кубики", как в LEGO.

Каждый шаг генерации — отдельный модуль. Текст разбираем, кодируем, генерим шум, чистим, декодируем. Смешивай как хочешь!

Всё так же просто

Гениальность в лёгкости. API остался родным, без заморочек:

pipe = ModularPipeline.from_pretrained("black-forest-labs/FLUX.2-klein-4B")

image = pipe(prompt="спокойный пейзаж на закате")

Снаружи — знакомо. А внутри — команда модулей: энкодер текста, денойзер, декодер. Всё само собирается.

Почему это прорыв

Гибкость — вот что цепляет. Хочешь лучший энкодер текста? Меняй одним движением. Добавь предобработку? Вставь кубик. Эксперименты с денойзингом? Легко!

Исследователям и девелоперам теперь не нужно переписывать всё. Подмени пару блоков — и тест готов.

Визуальный редактор: Mellon

Ещё круче — интеграция с Mellon. Это графический интерфейс на узлах. Тащи модули мышкой, соединяй стрелками. Как схему рисуешь.

Забудь про километры кода. Собери пайплайн визуально — и запусти!

Взгляд в будущее

Это как эволюция софта: от нуля к библиотекам. Теперь ИИ-кастом доступен всем. Не только гениям.

Сообщество взорвётся. Люди поделятся кубиками, создадут библиотеки. Сложные пайплайны без барьеров.

Мои мысли

За пару лет ИИ рванул вперёд, но Modular Diffusers — это "почему не раньше?". Интуитивно, практично. Станет стандартом.

Новичкам — готовые блоки. Профи — полная свобода. Убирай "тренировочные колёса" по мере роста.

Больше всего жду креатива: новые комбинации модулей. Взрыв инноваций в генерации изображений!

Источник: https://huggingface.co/blog/modular-diffusers