传统AI图像生成管道的痛点

你有没有过这种经历?想改改东西,结果只能全盘接受,或者从零重写?AI生成图片的世界就是这样。

以前,你就俩选择:用现成的管道,一点不改;要不就自己码一整套。跟买现成三明治似的,要么就自己种小麦磨面——中间没啥选项!

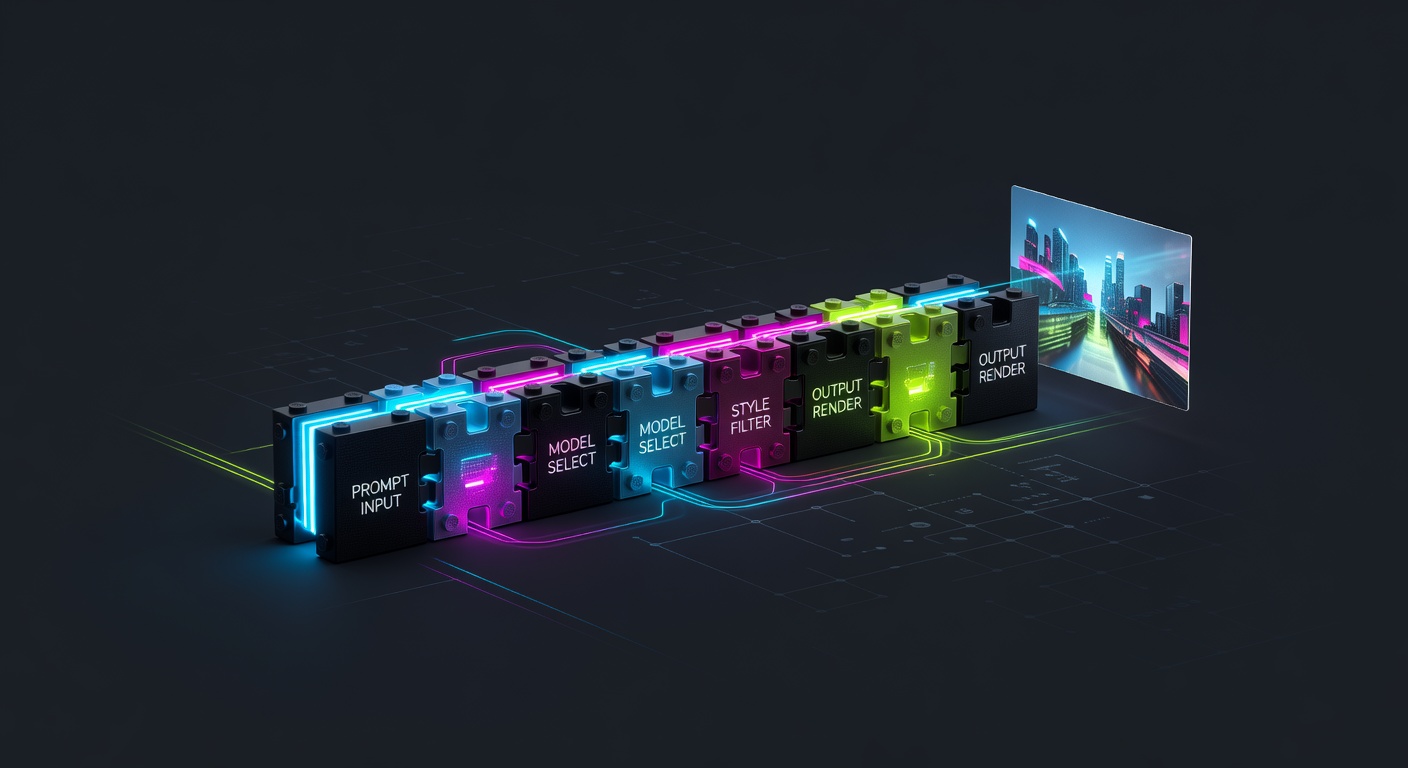

LEGO式AI来了

Modular Diffusers就牛了,它把这事儿彻底变了样。图像生成不再是个大块头,而是拆成一个个小积木,随便拼!

想想看,整个过程就那几步:读懂你的文字提示、编码、生成图片魔力、再解码成最终图。每个步骤单独成块,想怎么配就怎么配。

用起来超简单

最赞的是,它保持了熟悉的接口,一点不费劲:

# 跟以前一模一样...

pipe = ModularPipeline.from_pretrained("black-forest-labs/FLUX.2-klein-4B")

image = pipe(prompt="夕阳下的宁静山水")

但背后,它是堆专业小模块在协作:文本编码、图像编码、去噪、解码,全自动连起来。

为什么这么颠覆

这玩意儿解锁了无限灵活。想换个更好的文本编码器?直接换!加个自定义预处理?插个新块!试不同去噪方法?随便混搭!

对研究员和开发者来说,简直是福音。不用每次实验都重写一堆代码,换个块就行。

视觉工作流太酷了

更绝的是,它接入了Mellon——一个节点式的可视界面。拖拖拽拽,就能拼出流程!

想象下,像画流程图一样设计AI管道。不用死盯着代码墙,直接连线看效果,自定义工作流瞬间活了。

对未来的影响

这思路让我想起软件从零写到用库框架的进化。它把AI开发门槛拉低,谁都能玩复杂定制。

社区肯定会火爆。大家分享自定义块,建起组件库,搞出越来越牛的工作流,再没入门障碍。

我的看法

AI圈这几年飞速变化,这绝对是“早该这么干”的时刻。模块化太直观、太实用了,我猜它会成标配。

新手用现成块起步,专家逐步自定义,就像带辅助轮的自行车,想脱就脱。

最期待的是,大家乱拼一气,会爆出多少创意组合。AI图像生成的工作流,即将迎来创新大爆发!

来源:https://huggingface.co/blog/modular-diffusers