Falha no Copilot da Microsoft: Emails Privados em Risco

Ei, galera da tech! Se você usa o Microsoft 365 Copilot no dia a dia, fique ligado nessa notícia fresca. Um erro no assistente de IA está resumindo mensagens confidenciais, ignorando as proteções de segurança. Vamos entender o problema, o impacto e as ações da Microsoft.

O Que Está Rolando com Essa Falha?

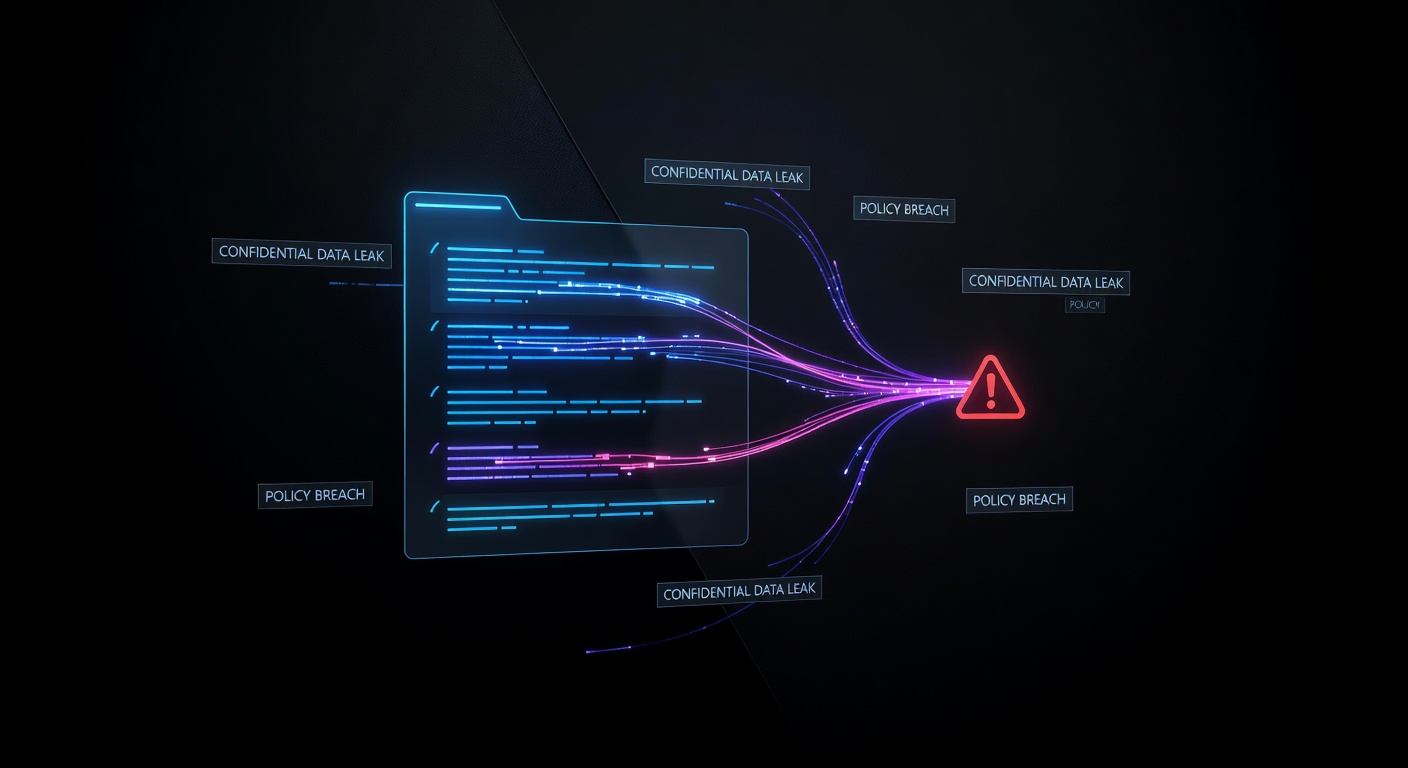

Desde o fim de janeiro, um bug no chat da aba "trabalho" do Copilot acessa e resume emails das pastas Enviados e Rascunhos. Empresas contam com políticas de prevenção de perda de dados (DLP) e etiquetas de confidencialidade para bloquear isso. São barreiras digitais que dizem "proibida a entrada" para ferramentas automáticas. Mas o erro, código CW1226324, passa por cima de tudo e processa o que não devia.

Pense no risco: um email sigiloso ou rascunho pessoal sendo analisado por IA sem aviso. Para negócios que dependem do Microsoft 365, isso é um problema sério.

Como o Copilot Funciona?

O Copilot é um ajudante de IA para turbinar a produtividade. Lançado para clientes empresariais pagantes em setembro de 2023, ele se conecta a Word, Excel, PowerPoint, Outlook e OneNote. Ajuda a criar textos, analisar planilhas ou resumir chats. A aba "trabalho" mexe com dados da empresa, por isso esse bug assusta tanto – ele invade áreas restritas por falha no código.

A Microsoft confirmou: "Mensagens com etiqueta confidencial estão sendo processadas errado pelo chat do Copilot". Erro puro de programação.

Resposta da Microsoft: Correção em Andamento

Boa notícia: a empresa agiu rápido. Descobriu o problema em 21 de janeiro e começou o conserto no início de fevereiro. Hoje, monitoram a implementação e contatam usuários afetados. Sem prazo final ou números exatos de impactos divulgados.

Chamado de "aviso", sugere alcance limitado. Mas investigações podem revelar mais. Fique de olho.

Por Que Isso Importa?

Usuários de Microsoft 365, principalmente empresas, precisam se preocupar. Privacidade de dados protege segredos comerciais, infos de clientes e comunicações internas. Quando IA furubu segurança, dados sensíveis vazam, mesmo sem má intenção.

Isso expõe o dilema da IA: avanços rápidos versus riscos reais. Sistemas assim são feitos por humanos, e erros acontecem.

O Que Fazer Agora?

Enquanto a Microsoft corrige, proteja-se:

- Verifique Etiquetas: Confirme se emails sensíveis têm marcas certas e DLP ativa.

- Restrinja Acesso: Bloqueie pastas ou desative o chat do Copilot por enquanto.

- Acompanhe Notícias: Siga atualizações da Microsoft. Podem notificar diretamente.

Visão Geral

Não é só um bug isolado; é questão de confiança em IAs. Ferramentas como Copilot entram no workflow diário, mas devem respeitar limites de privacidade. A Microsoft costuma resolver bem, mas casos assim abalam, sobretudo para quem lida com dados críticos.

E você, já topou algo estranho com IAs? Comente aí! Se curtiu, compartilhe. Vamos debater tech e privacidade.

Fonte: BleepingComputer