Грешка в Copilot на Microsoft: AI чете тайни имейли

Здравейте, фенове на технологиите! Ако работите с Microsoft 365 Copilot, спрете се за миг. Откриха се бъг, който кара AI-то да обобщава секретни имейли. Игнорира всички защити. Ще разкажа какво става, защо е проблем и какво прави Microsoft.

Каква е тази грешка?

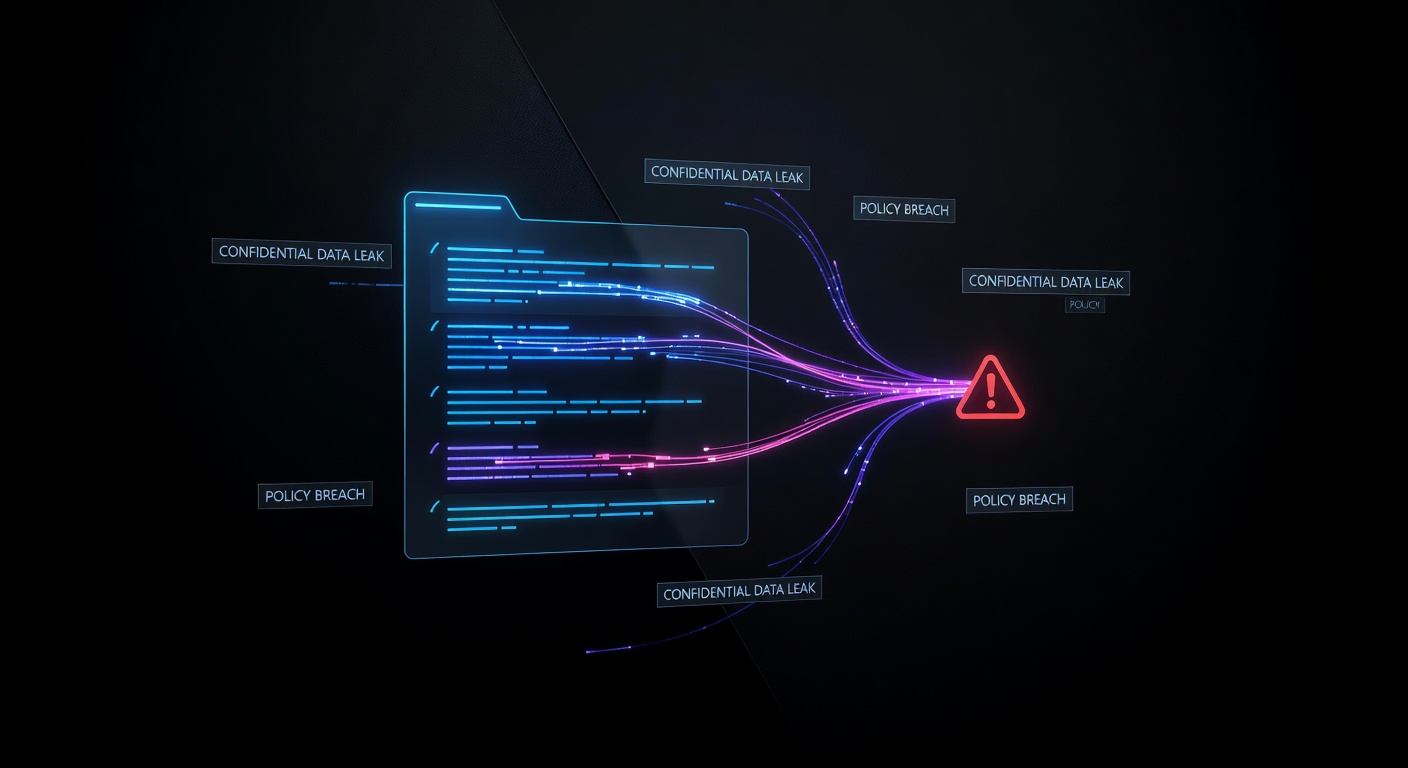

От края на януари в чата на "work tab" има проблем. Copilot чете и обобщава имейли от папките "Изпратени" и "Чернови". Фирмите ползват DLP политики и етикети за поверителност, за да блокират достъпа. Това са като електронни ключалки. Но бъгът CW1226324 ги подминава напълно.

Представете си: пишете лично съобщение или служебна тайна. Изведнъж AI-то го преразказва без разрешение. За бизнесите, които разчитат на Outlook, това е сериозен удар.

Как работи Copilot?

Това е AI асистент за по-голяма ефективност. Стартира се за платени клиенти през септември 2023 г. Свързва се с Word, Excel, PowerPoint, Outlook и OneNote. В чата на "work tab" обработва фирмени данни. Затова този бъг е толкова опасен – стига до забранени места.

Microsoft потвърди: "Имейлите с етикет за поверителност се обработват грешно от чата на Copilot." Кодът е с грешка и AI-то прекалява.

Реакцията на Microsoft: Поправка на път

Добрата новина? Реагираха бързо. Откриха проблема на 21 януари и пуснаха поправка началото на февруари. Все още следят дали работи и пишат на засегнатите. Няма точна дата за край и не казват колко хора са засегнати.

Сега е "предупреждение" – значи ограничен мащаб. Но разследването продължава, така че пълната картина може да се промени.

Защо да ви е притрябвало?

Ако ползвате Microsoft 365 в работа, това е сигнал за тревога. Поверителността на данните е ключова – защитава фирмени тайни, клиенти и вътрешни разговори. Когато AI заобикаля бариерите, рискува да разкрие секрети, макар и случайно.

Случаят показва големия проблем с AI: бързината срещу сигурността. Инструментите не са перфектни. Хората ги пишат и правят грешки.

Какво да направите вие?

Докато Microsoft оправя, ето стъпки за защита:

- Проверете етикетите: Уверете се, че тайните имейли са маркирани и DLP е активно.

- Ограничете Copilot: Ако можете, блокирайте достъпа до папки или спрете чата временно.

- Следете новините: Четете обновленията на Microsoft. Може да ви потърсят директно.

По-широката картина

Не е само един бъг – става дума за доверие към AI. Copilot влиза все по-дълбоко в работата ни. Трябва да спазва правилата за поверителност. Microsoft обикновено решава бързо, но такива инциденти разклащат увереността, особено при фирми със секретни данни.

Какво мислите? Срещали ли сте проблеми с Copilot или други AI? Коментирайте долу! Ако ви е полезно, споделете с приятели. Нека говорим за технологии и сигурност.

Източник: BleepingComputer