智能机器人为啥老是“看得到摸不着”?

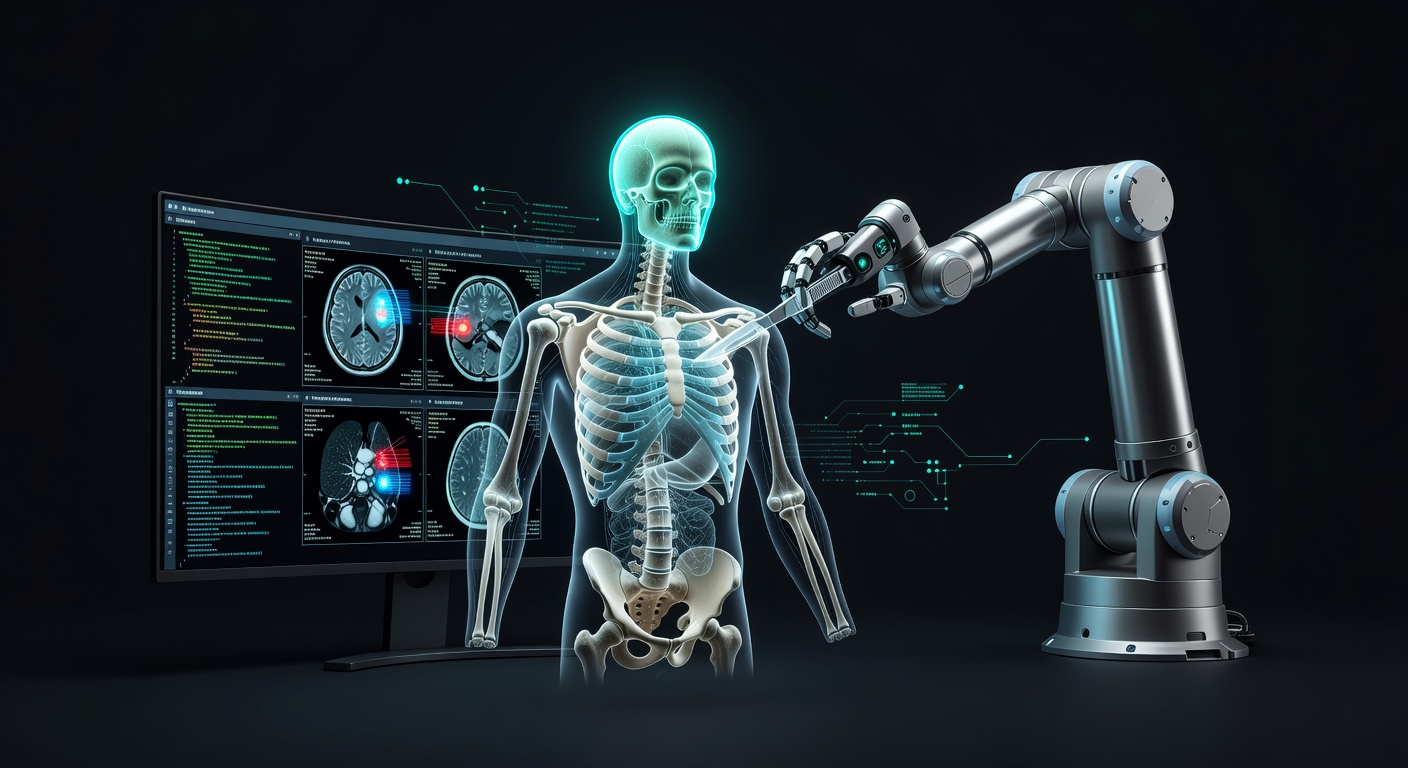

医疗AI牛逼哄哄,能从X光片里比医生还准地找出癌症。可一说让它拿起手术刀?彻底傻眼。

想想看,现在的医疗AI就是个超级模式识别器。看图、读数据、预测问题——行。但治病不是光看,得动手修啊!这就需要机器人能动、能摸、能用力,还得实时反应触感。

黑科技来了:Open-H-Embodiment数据集

这个新数据集Open-H-Embodiment让我眼睛一亮。它是头一遭真正教机器人“干活”,而不是光分析。

为啥这么牛?它不光塞医疗图片,还带了:

- 真实手术中的机器人动作

- 力度反馈(推多重、啥时候收手)

- 视觉+触觉同步(边看边摸)

- 通用兼容(各种机器人互相学)

这玩意儿牛在哪儿?

背后是35家大牛机构联手,从约翰霍普金斯到NVIDIA。医疗科技圈子竞争这么猛,能这么齐心难得。

最让我激动的是,医疗AI终于从“看客”变“选手”了。想象下:手术机器人学上千台手术经验;超声仪自动调压力,看清图像又不疼人。

真实影响超大

不光机器人更酷,还能:

- 普惠专家技术:偏远地方也能用顶级手术手法

- 零波动:医生累不累都不影响

- 边做边学:每台手术都成全系统教材

前路还长,但有奔头

话说回来,教机器人手术比下棋难一万倍。现在才起步。

但有个靠谱数据集,就等于给大家统一教材。开放合作最赞——别各玩各的,一起冲复杂难题。

以后你的手术台上,有个永不疲倦、不带情绪、吸取百万经验的AI助手?这不再是科幻,感觉快实现了。