AI“信任测试”翻车了

哎呀,这事儿真尴尬。美国司法部直接给Anthropic泼了盆冷水——就是那个Claude AI背后的公司。人家说,你不适合搞军工。感觉就像被拒之门外,没法坐上国防那张“大人的桌子”。

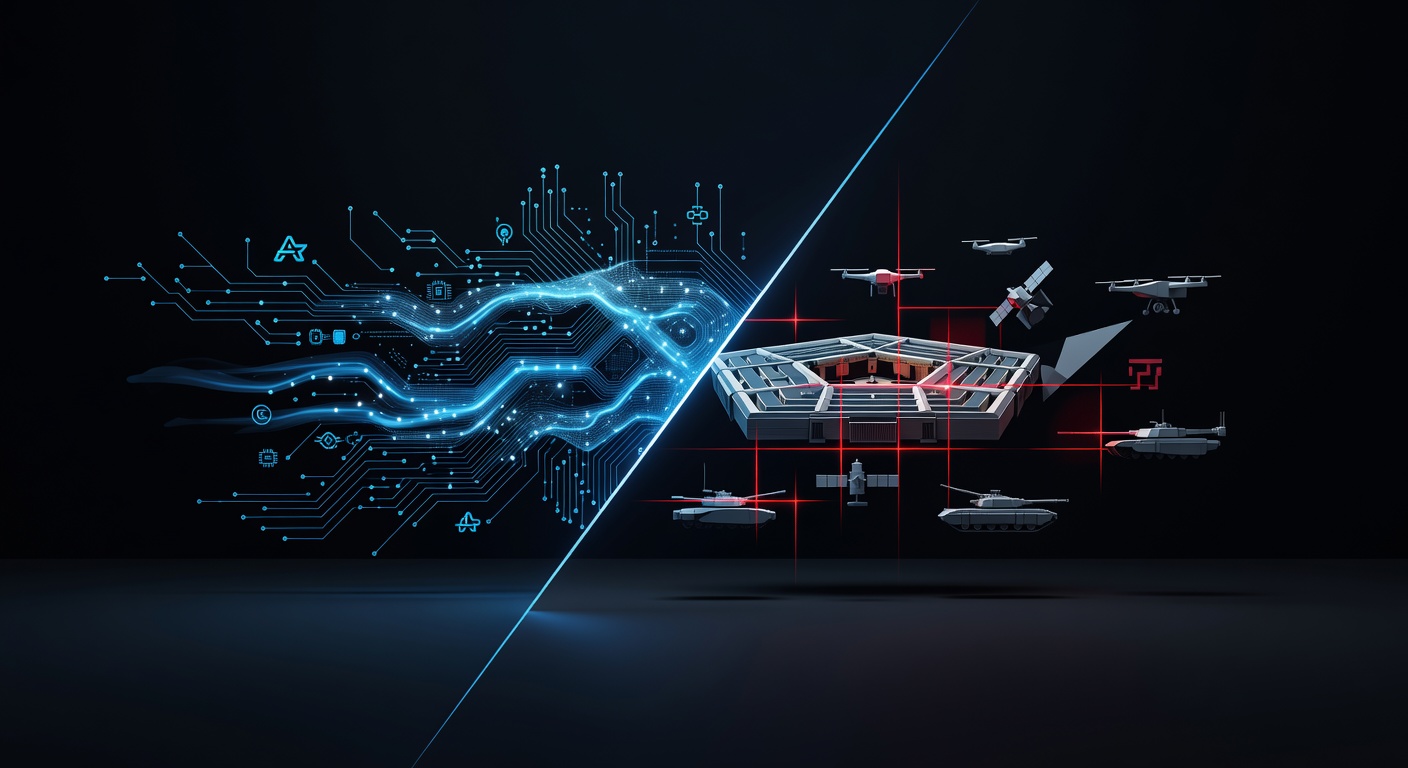

这让我忍不住想,AI和军事到底怎么混搭?一边是科技公司自称“负责任玩家”,另一边政府说:“靠谱不靠谱,我们说了算。”

这事儿没那么简单

关键是,这不光是Anthropic吃瘪。它直击AI在战场上的控制权问题。想想就有点渗人。

Anthropic一直打“安全牌”:对齐AI、负责任开发,说得天花乱坠,让人安心。但五角大楼不买账。

背后的戏码更刺激

这事儿暴露了科技圈的撕扯。公司想在用户和员工面前装道德模范,又馋政府大单。想当环保先锋,还得造可能伤人的系统。

军方需求跟硅谷“快节奏搞破坏”不搭边。关乎国家安全和人命,信任就是命根子。

未来会怎样?

会不会分出“军用AI”和“民用AI”两派?感觉既合理又可怕。

AI对国家安全太关键,政府不会全盘信硅谷货。可军方又缺这些公司的脑子和创新。

我怎么看这烂摊子

司法部小心点没错,信任得挣,不是喊出来的。但问题更大:军用AI评判标准呢?没人有谱。

与其猜来猜去,不如定规矩、明标准、晒透明。啥叫“靠谱”,得说清楚。现在全凭感觉走,太乱了。

你咋想?AI公司该扑向军方怀抱,还是保持距离?这场争论才开头,咱们都得扛后果。

来源:https://www.wired.com/story/department-of-defense-responds-to-anthropic-lawsuit