当前AI编程测试的硬伤

最近总觉得测试AI编程能力的方式不对劲。我们问的问题,从根上就错了。

打个比方,考开车技术只让你在空荡荡的停车场倒一次车。完美通过了?行啊。但真让你在高峰期堵车里熬几个月呢?

AI编程测试基本就这样。扔个问题,让AI写段代码,跑通了就叫高分。可真实开发压根儿不是这么玩的。

真实编程啥样

现实中,你写完代码就拍屁股走人?想得美。天天得:

- 加新功能,还得跟老代码磨合

- 修几个月后冒出来的bug

- 重构旧代码,适应新需求

- 确保改动不崩其他地方

乱七八糟,反复迭代,得提前想代码怎么演化。今天牛逼的hack,半年后可能变地狱。

SWE-CI:玩真的长跑测试

研究者终于醒悟,搞出SWE-CI——首个真刀真枪测AI长期维护能力的基准。

不是一次性问题,而是模拟真实软件演化:

- 100个编程挑战

- 每个平均233天开发历史

- 平均71次连续提交

- 多轮分析、迭代Coding

牛就牛在这里。它不光看代码对不对,还考代码能不能长期维护。

为啥这事儿超重要

醒醒:软件维护占项目成本60-80%。没错,大头钱都砸在养老代码上,不是加新功能。

之前我们只测了简单那20-40%。

研究提Lehman's Laws:软件不维护就自然衰败。像代码界的熵增,越改越乱。

对AI开发的冲击

SWE-CI是转折点。别再问“AI会不会写代码”,得问“AI写的代码,人家能长期接手吗?”

区别巨大。一个AI硬编码过测试,另一个写得干净易扩展。现在测试俩都满分。但现实里,后者价值爆表。

更大的格局

这让我想:AI得学资深开发者思维,别只当菜鸟。

菜鸟只求代码跑起来。资深大佬求代码好改、好debug、好扩展。脑子里想着半年后接手的哥们儿(可能是自己)。

SWE-CI是头一遭真测这种长远眼光。

展望未来

超期待现有AI在SWE-CI上的表现。我猜大多数会栽在维护环节,就算单题无敌也白搭。

但这不是坏事——指明方向。别光让AI写得快,得写得好,经得起时间考验。

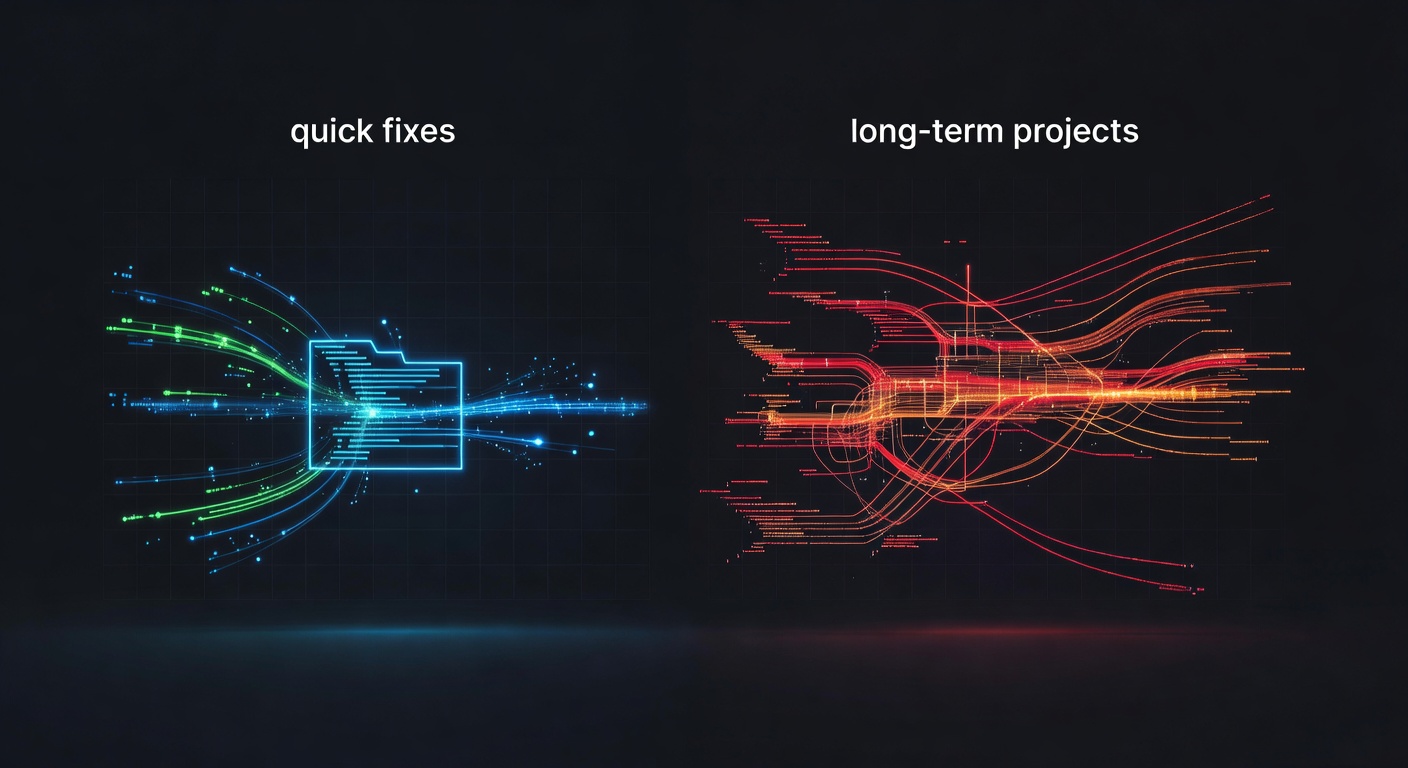

你咋看?用过AI助手,短期fix和长期项目有啥区别?评论区聊聊你的经历。

来源:https://arxiv.org/pdf/2603.03823