客厅里的机器人革命

我追机器人技术好几年了。说实话,我每天最常打交道的不是什么高端人形机器人,而是家里的扫地机器人。它绕着茶几转悠,看起来不起眼,却代表了大突破:真正聪明的机器人在真实世界里干活。

最让我激动的是,现在的机器人不光照着固定路线走。它们开始懂自己看到的,能瞬间决定下一步怎么动。

从聊天AI到机器人大脑

你知道ChatGPT能看懂文字和图片吧?科学家们正用类似AI去操控机器人手臂和身体。这些叫“视觉-语言-行动”模型(简称VLA),简单说,就是让机器人看一眼现场,就知道该干啥。

想象一下:不是聊天机器人吐出一堆字,而是直接伸臂拿起你的咖啡杯。酷毙了,对吧?

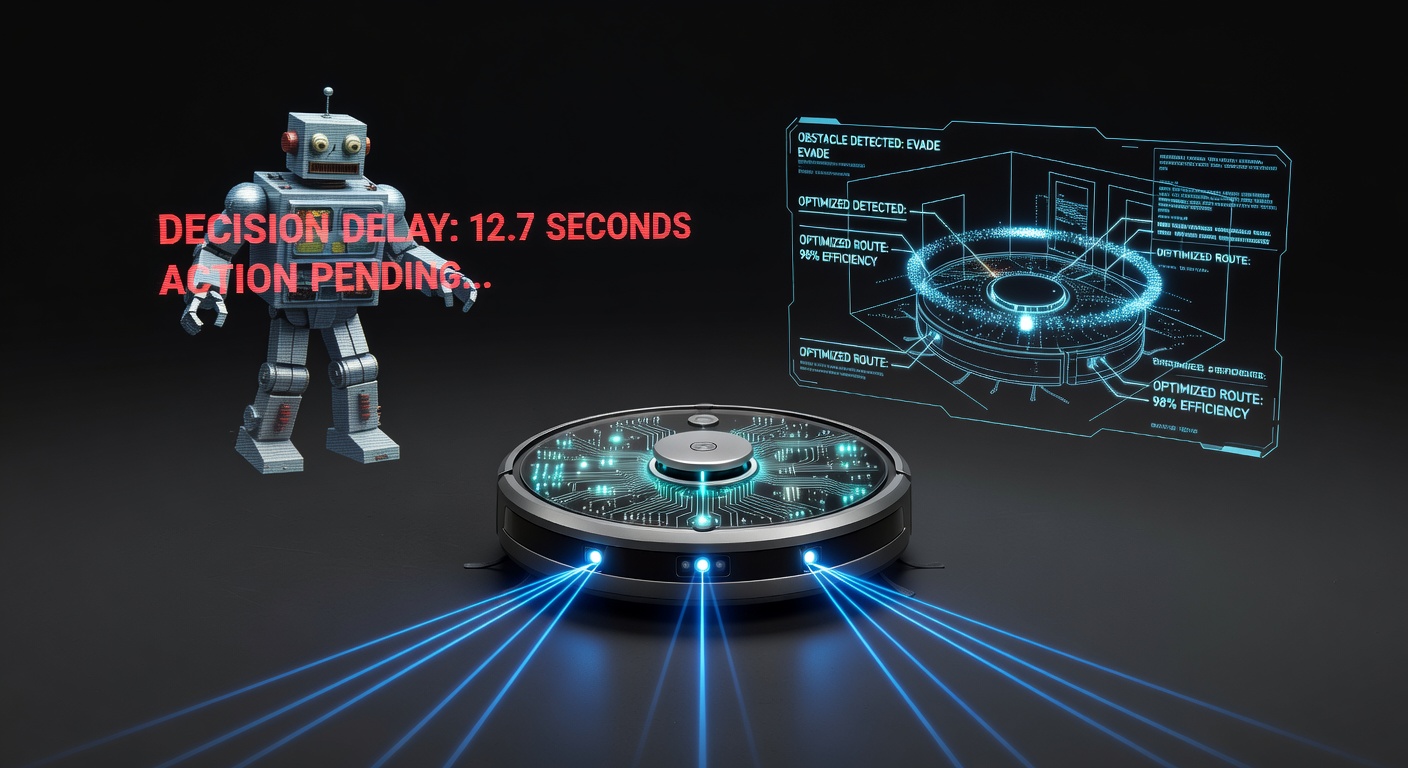

真难题:让机器人反应超快

有趣的地方也在这儿——难点就在速度上。这些AI牛归牛,得靠数据中心的大电脑跑。可机器人不能老连云端,得本地思考,瞬间决策,还得用手机级别的算力。

时间问题超关键:比如机器人臂抓掉落的球。要是“脑子”花2秒看清再想动作,球早砸地上了。要流畅自然,得毫秒级响应。

这就闹了个笑话——我们得把台式机AI塞进手机硬件里。

教机器人:靠示范,不是死编程

最近进展让我眼前一亮。现在不一个个场景编程了(那太不可能),而是用视频示范教它们。

比如教泡茶:你当场演示一遍,摄像头全录下来。机器人看视频,学模式,然后自己适应点小变化。

但有个坑——示范质量决定一切。就像教朋友做饭,你手势乱七八糟、光线还晃,他们准学不会。

这跟你有啥关系

你可能想:“听起来牛,但啥时候轮到我家?”快了,比你想的快。

研究里的黑科技已经在民用产品上落地。我那扫地机器人,下代可能懂“绕着圣诞树吸尘,别碰礼物”这种语音指令。

仓库机器人会处理各种形状包裹。手术机器人更准更灵活。汽车呢?本质就是学着在乱七八糟的环境里开。

背后的工程黑科技

这不光是AI的事儿,是整套系统工程。得有:

- 聪明调度:脑子提前想下一步,身子还忙着上一步

- 优化硬件:芯片传感器全高效协作

- 实时无延迟:物理世界不许卡顿

像NXP这样的公司,正搞专为机器人设计的处理器。不是玩游戏显卡,而是实时懂世界、做决策。

未来咋样

我真心期待。机器人将不只按剧本走,而是真懂环境、随机应变。

不会一夜爆发的,是每月小步优化:更高效、更稳、更便宜。智能塞进小盒子。

说真的,等机器人像我们一样,看懂、想通、行动自如,那能解决多少难题啊。

机器人未来,不是造更好机器,而是让它们自己动脑。

来源:https://huggingface.co/blog/nxp/bringing-robotics-ai-to-embedded-platforms